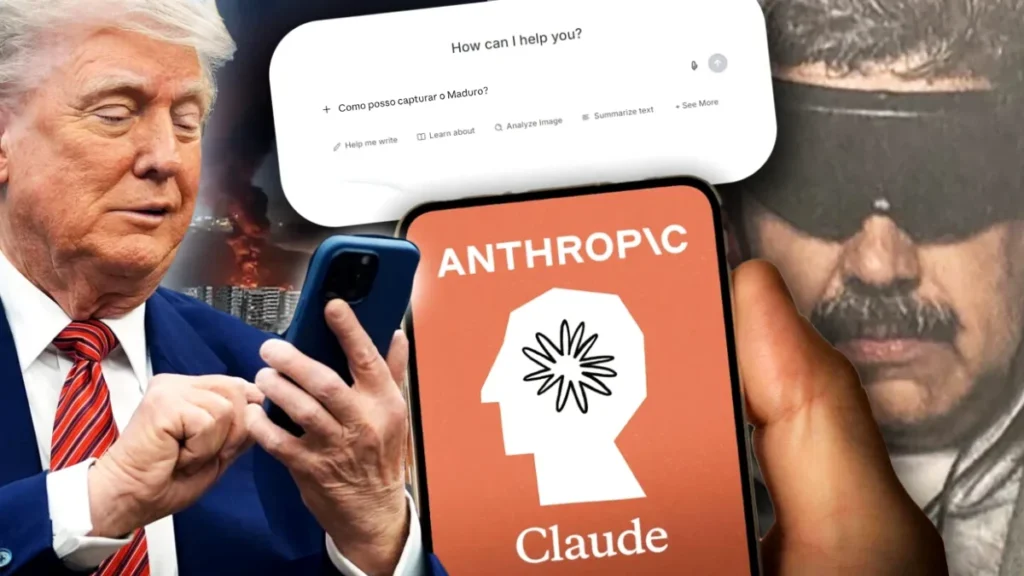

Exército dos EUA usa a IA Claude para atacar a Venezuela e capturar Maduro

descricao

No front de tecnologia e geopolítica, surge a mesma pergunta: até onde a inteligência artificial entra na prática militar? De acordo com o Wall Street Journal, o Claude, IA desenvolvida pela Anthropic, teria participado de uma operação norte‑americana em Caracas com o objetivo de capturar Nicolás Maduro e a sua esposa. Segundo a narrativa divulgada, seria a primeira vez que uma IA comercial teria sido acionada num ataque classificado. E o que deveria continuar como uma discussão aberta se tornou, no mínimo, uma lembrança de Pandora: até que ponto as plataformas de IA entram na tomada de decisões de guerra?

A Anthropic, por meio de um porta‑voz, não confirmou integralmente o uso do Claude, ressaltando que não é possível comentar operações específicas, classificadas ou não. O Departamento de Defesa também permaneceu em silêncio. Ainda assim, as informações apontam que o Claude pode ter desempenhado um papel em bombardeios realizados para a captura de Maduro, conforme relatações que envolvem a atuação de Palantir, fornecedora de software de análise de dados há décadas, ligada ao arsenal americano. E, no centro da discussão, está a própria política de uso da Anthropic: não permitir violência explícita, não desenvolver armas e não facilitar operações de vigilância em termos gerais. O conflito, porém, parece ter cruzado a fronteira dessas regras em um contexto militar.

O episódio envolve, ainda, um contrato de 200 milhões de dólares entre a Anthropic e o Departamento de Defesa. O CEO Dario Amodei já havia manifestado, publicamente, dúvidas sobre o emprego de IA em operações letais autônomas e na vigilância interna. Entre as linhas da negociação, ficou registrado que uma cláusula permitiria à Anthropic “>adaptar as restrições de utilização” para clientes governamentais específicos, desde que as garantias contratuais fossem consideradas suficientes. Em outras palavras: o que, para o público em geral, é proibido, pode receber autorização por meio de um acordo privado com o governo.

Essa pressão divergente ficou evidente durante a negociação entre o Pentágono e a Anthropic. Ao anunciar uma parceria com a xAI em janeiro — que acabou não indo adiante —, Pete Hegseth, então ao redor da Defesa, comentou que o conjunto de modelos de IA não deveria bloquear a capacidade de fazer a guerra. A declaração parecia mirar diretamente a Anthropic, que, por sua vez, manteve limites claros, especialmente quando o assunto envolve armas autônomas e monitoramento em massa. No fim das contas, a relação entre princípios éticos da empresa e pressões governamentais gerou uma película de ambiguidade que torna difícil traçar os contornos exatos do papel do Claude na operação.

O debate envolve ainda o histórico entre a administração Trump e a Anthropic, com críticas de desregulação e preocupações sobre exportação de chips. A empresa sustenta que o contrato de 200 milhões não compromete suas políticas; no entanto, a presença do acordo alimenta a discussão sobre até que ponto um acordo pode, de fato, permitir usos indevidos ou não transparentes em campo de batalha. O véu de opacidade sobre onde começa e onde termina o uso letal da IA é o fio condutor de todo o enredo: quem sabe exatamente o que o Claude fez, quando começou a influenciar decisões ou quando deixou de agir apenas como suporte analítico?

A matéria destaca que a comunidade tecnológica costuma diferenciar entre o processamento de informações, a análise de relatórios e o auxílio à estratégia — tarefas que, na prática, exigem diferentes níveis de responsabilidade. Entre os extremos — desde a interpretação de documentos até o controle de drones autônomos — há uma distância considerável que não pode ser ignorada, especialmente quando há foco em decisões de ataque real. A Anthropic, até o momento, não detalhou o papel preciso do Claude, protegendo-se juridicamente pela falta de uma linha clara que demonstre onde se rompeu ou não algum limite técnico ou ético. E, ainda assim, a própria reputação da empresa repousa sobre a ideia de segurança, transparência e limites bem definidos para o uso de IA.

Como pano de fundo, destacam‑se referências à atuação de grandes players do ramo: a OpenAI e a Google teriam se tornado parte de plataformas militares utilizadas por milhões de pessoas, com aplicações declaradas em análise de documentos, geração de relatórios e apoio à investigação — áreas que, embora não letais, já colocam em evidência o debate sobre usos aceitáveis da IA em contextos sensíveis. Por ora, o Departamento de Defesa dos EUA confirmou o contrato com a Anthropic, com teto de 200 milhões, inserido em um programa maior de integração de IA comercial em operações de segurança nacional. A pergunta central continua sem resposta: onde exatamente começa o uso letal da IA? Em dados, em recomendações de alvos, em cálculos de trajetórias?

Ao final, o contrato que permite “adaptar as restrições” não define regras concretas e abre espaço para interpretações diferentes entre quem financia, quem regula e quem opera no terreno. A administração de então chegou a cogitar cancelar o acordo caso a Anthropic continuasse a restringir certos usos — um gesto que demonstra a sensibilidade do tema. Enquanto isso, a empresa afirma manter seus princípios e as suas políticas, mantendo silêncio sobre o que realmente aconteceu em Caracas. Assim, a ambiguidade técnica persiste, permitindo que a Anthropic sustente um discurso ético ao mesmo tempo em que negocia com o maior executor de operações de segurança do mundo. E para você, leitor, até que ponto a IA deve participar de decisões de guerra na prática?

- Ambiguidade técnica sobre o papel exato do Claude na operação e onde começa o uso letal.

- Contrato de 200 milhões com o Departamento de Defesa, com possibilidade de adaptar restrições.

- Pontos de vista divergentes entre Anthropic, Pentágono e autoridades americanas sobre limites e aplicações da IA.