O verdadeiro perigo da inteligência artificial é a estupidez humana

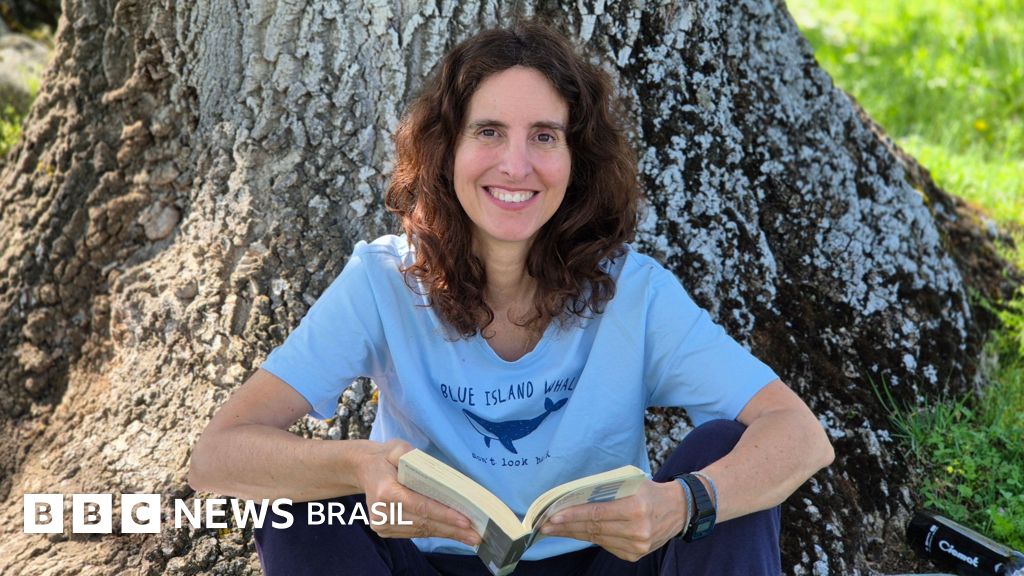

A jornalista e escritora espanhola Laura G. de Rivera acredita que estamos deixando a inteligência artificial decidir demais sobre nossas vidas. Seu livro é um manual de resistência aos algoritmos que nos cercam.

À noite, quando decidimos sair para jantar, parece que a presença da IA já adianta o cardápio: vídeos de tacos vistos pela tarde podem estar moldando o que pensamos pedir hoje. E se não tomarmos as rédeas das nossas escolhas, alguém — ou algo — pode passar a decidí-las por nós. Essa ideia aparece como alerta no pensamento da autora Laura G. de Rivera, que relembra que a liberdade e a imaginação podem ser puxadas para caminhos que o algoritmo trilha com base em dados. Em entrevista recente, ela citou como exemplo os experimentos de Michal Kosinski, psicólogo de Stanford, que mostrou que crianças, jovens e adultos podem ter seus gostos estimados com alta precisão a partir de traços digitais. No fim das contas, a capacidade de prever necessidades é real; o custo é cada vez mais alto: perdemos a autonomia de pensar por nós mesmos.

Para Rivera, o problema não é a máquina em si, mas o uso que fazemos dela. A ideia de que a tecnologia pode substituir a curiosidade humana é, na prática, a distância entre assistir a conteúdos e cultivar a própria imaginação. Ela lembra que, para manter a liberdade individual, é essencial reconhecer como as plataformas geram valor a partir dos dados que deixamos para trás — e que esse modelo financeiro depende da nossa disposição de repetir hábitos, curtir e compartilhar. Em sua leitura, não é apenas uma questão de eficiência: é uma discussão sobre quem dita o ritmo das nossas decisões diárias.

O Hay Festival, que reuniu especialistas de várias partes do mundo em Arequipa, ajudou a ampliar o debate sobre o que está por trás dessas previsões. Rivera cita tanto a promessa quanto os riscos: se as máquinas podem prever o que queremos, é preciso perguntar: com que finalidade? Quando a previsão vira norma, quem estuda o que é permitido ou rejeitado pode acabar ficando para trás. E, por vezes, a escolha mais simples — aceitar o que o algoritmo oferece — pode significar abrir mão de experiências autênticas no dia a dia.

Como frear esse avanço sem abrir mão dos benefícios da tecnologia? A resposta, para Rivera, é simples, acessível a todos e sem impacto ambiental: pensar. O pensamento crítico é a ferramenta que pode defender a liberdade frente ao controle algorítmico e à tal “vontade de terceiros”. Ela aponta que, quase sempre, o maior obstáculo é a própria preguiça: o uso constante do celular nos distrai de observar a sala de espera do consultório ou o tédio em casa. Esses momentos, que antes cabiam à mente, hoje são substituídos pela tela que injeta estímulos incessantes.

No cotidiano, várias partes desse ecossistema ajudam a entender o risco. É quase inevitável fornecer dados ao se inscrever em serviços, e decifrar as letras miúdas dos termos pode parecer uma tarefa fútil. Ainda assim, a mensagem é clara: entender como o modelo de negócios funciona é essencial para reduzir o que podemos chamar de exploração involuntária do nosso comportamento. A partir daí, questionar o que as plataformas realmente entregam — e por qual preço — torna-se um hábito valioso. E sim, é preciso refletir sobre como contratos, cookies e dados se cruzam com decisões que afetam nossa vida, nossa saúde e nossa opinião.

Quais são, afinal, os perigos de confiar cegamente nas previsões automáticas? O consenso entre os estudiosos é que o risco não está na IA em si, mas no uso que fazemos dela. Quando decisões importantes passam a depender de máquinas — até em situações de vida ou morte —, é comum que as pessoas acreditem que, se um computador disse algo, aquilo é verdade. Nesse cenário, a pergunta que fica é simples, porém perturbadora: a quem vamos deixar a escolha final?

Essa é uma questão antiga da humanidade. Rivera cita a lucidez de Erich Fromm, que tratava do medo da liberdade: muitos preferem obedecer a um comando externo a ter que decidir por si mesmos. A capacidade de agir sozinho continua sendo um traço humano essencial, sobretudo quando o assunto envolve responsabilidade, ética e empatia. E é justamente esse conjunto de qualidades que não pode ser substituído por algoritmos.

Mas existem casos que ajudam a entender onde a linha entre alerta e abuso pode se cruzar. Snowden, que denunciou sistemas de vigilância em massa, para Rivera, é um dos nomes que abriram olhos sobre as implicações de deixar governos e plataformas monitores controlarem dados. Outros exemplos, como Sophie Zhang, Timnit Gebru e Guillaume Chaslot, mostram como a manipulação de redes, vieses e recomendações pode distorcer a visão pública e favorecer discursos discriminatórios ou desinformação — muitas vezes sem que haja uma resposta rápida de quem tem o poder de corrigir isso. Essas histórias reforçam a ideia de que a vigilância, a transparência e a ética precisam caminhar lado a lado com o avanço tecnológico.

Qual é, então, a esperança que sobra? A visão de Rivera é de que nenhum software criativo pode, por definição, inventar algo realmente novo sem se apoiar em dados passados. Da mesma forma, a empatia e a solidariedade permanecem como atributos exclusivamente humanos. Por isso, o caminho não é abandonar a tecnologia, mas orientar seu uso com responsabilidade — e com uma boa dose de ceticismo saudável sobre o que é ou não essencial para nossas vidas.

No fim das contas, a mensagem é simples: cultivar a capacidade de pensar, questionar e exigir transparência não é apenas possível, é indispensável. Pequenas atitudes no dia a dia podem frear a dependência excessiva de algoritmos, ajudando a manter vivo o espaço humano da imaginação, da criatividade e da empatia.

- Estimular o pensamento crítico para não se tornar refém de sugestões algorítmicas

- Entender como funciona o modelo de negócios das grandes plataformas

- Rejeitar, sempre que possível, o uso indiscriminado de cookies e dados

- Pressionar por regulamentação e ética nas empresas que atuam com IA

Compartilhe este Artigo: